| Модератор форума: Yuri_G |

| Сообщество uCoz » Вебмастеру » Общие вопросы от вебмастеров » Заблокировано в файле robots.txt (подскажите как исправить) |

| Заблокировано в файле robots.txt |

|

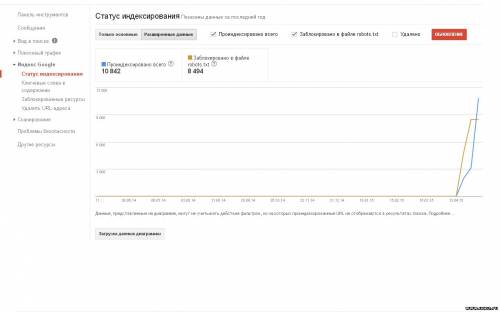

в гугл вебмастере вот такой график по индексации.

это так должно быть? или нет? файл robots.txt я свой не создавал, так как я понимаю в юкозе есть базовый Прикрепления:

8444398.jpg

(70.2 Kb)

|

|

vanovoevoda, адрес сайта укажите

|

|

$Vladimir$, http://ex-tor.net/

Добавлено (10 Май 2015, 08:42:43) |

|

Согласно данным системы домен вы сменили 2015-04-14. Также на страницах встречаются ссылки на старый домен, который закрыт от индексации пример со страницыДоступно только для пользователей |

|

$Vladimir$, так, выходит, сайт из-за этого так тупит? из-за старых ссылок? или что мне ещё нужно сделать, чтоб он поскорее восстановил трафик? подскажите, пожалуйста

|

|

vanovoevoda, вы закрыли старый домен к индексации поэтому медленнее все идет. в яндексе задержка из-за поломки зеркальщика. в гугле и яндексе из-за того, что вы закрыли к индексации стандартный домен

что у вас тупит? на переиндексацию надо около двух месяцев, на полную склейку может уйти чуть больше в вашем случае. вы наделали ошибок, не дождались даже месяца и у вас все тупит? роботс менять не стоит. если что-то важное заблокировано в роботсе, то гугл выдаст список заблокированного если список есть предъявите его, но не на картинке на которой ничего не видно, нужны списки конкретных урлов |

|

webanet, так а почему Заблокировано в файле robots.txt аж 8500 ? или что это такое?

Добавлено (10 Май 2015, 20:01:29) |

|

Попробую вам объяснить. Как я понимаю у вас на страницах есть ссылки http://extor.at.ua/Kartinki/load.png - этот и подобные адреса прописали Вы или тот кто делал Вам сайт. Правильно было бы прописать тоже самое но без "extor.at.ua" и тогда не в зависимости от того какой у вас домен прикреплен - ссылка будет всегда рабочей. И так как у Вас стоит запрет в роботсе по старому домену http://extor.at.ua/robots.txt User-agent: * Disallow: / то все ссылки начинающиеся с extor.at.ua будут не доступны поисковикам. Поэтому Яндекс и Гугл будут ругаться и выдавать что у вас много страниц запрещенных к индексации. Что делать не подскажу ибо нет опыта, да и сам примерно в вашей ситуации )) Добавлено (10 Май 2015, 21:46:55) |

|

barocha69, понятно. я поубирал уже ссылки те на .at.ua, просто я не думал, что это так влияет на индексацию. дизайн сам делал.

Добавлено (10 Май 2015, 22:57:52) |

|

vanovoevoda,

Цитата так а почему Заблокировано в файле robots.txt аж 8500 ? или что это такое? так много из-за того, что скорее всего у вас много тегов на сайте, плюс ваша любовь к созданию мусорных страниц примеры страниц-мусора http://ex-tor.net/index/ssylki_2/0-29 вообще надо удалить в глазах робота - это пустая страница-ссылкопомойка. все ссылки на странице кроме тегов открыты и к тематике сайта не имеют отношение. второе место в номинации страница-мусор http://ex-tor.net/index/stranica_poiska/0-4 поисковую форму можно было ввернуть на страницах сайта и не создавать отдельную совершенно пустую в глазах поисковых роботов страницу третье место в номинации страница-мусор http://ex-tor.net/index/dobavit_torrent/0-25 у вас же и так на каждой странице материала и комментария есть теги кстати. на каждой странице материала и комментария у вас висят по две мертвые ссылки Как качать? | Помощь сайту! попытки украсить их картинками не увенчались успехом и сделали их 404 |

|

webanet, ссылки пустые в роботс запретил, теги внизу удалил. посмотрим. спасибо.

а вот ещё: может мне всё же поставить индексацию по обеим доменам? или уже пусть так будет? как лучше? Добавлено (11 Май 2015, 02:58:24) Добавлено (11 Май 2015, 03:06:53) |

|

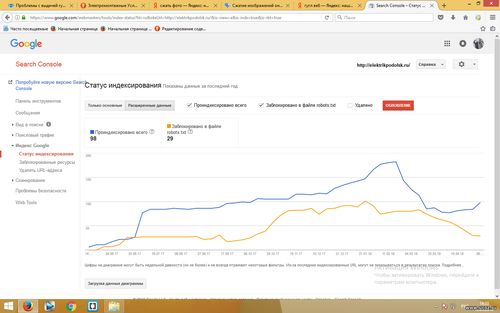

Прошу помочь с аналогичной проблемой. Адрес сайта - http://elektrikpodolsk.ru

$IMAGE1$ Сообщение отредактировал Elektrik8209 - Понедельник, 07 Май 2018, 23:01:23

|

|

Elektrik8209, что на скрине? какие ссылки заблокированы? чтобы скрин отображался он должен быть меньше 500 кб

|

|

webanet, спасибо, завтра подготовлю скрины.

Сообщение отредактировал Elektrik8209 - Вторник, 08 Май 2018, 23:40:04

|

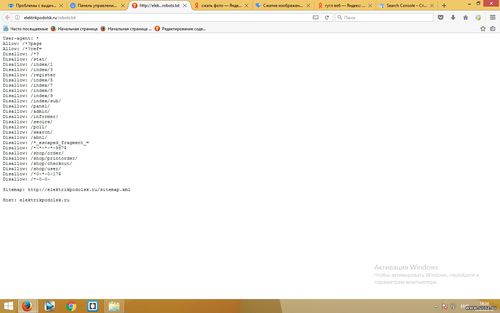

Скрины робота и график. Не подскажете, откуда такая динамика на графике по количеству запрещенных страниц? Кто их запрещает? Прикрепления:

4035981.jpg

(151.8 Kb)

·

0463641.jpg

(110.3 Kb)

Сообщение отредактировал Elektrik8209 - Суббота, 12 Май 2018, 14:41:49

|

| |||

Чат сообщества

Чат сообщества