|

|

| Модератор форума: Yuri_G |

| Сообщество uCoz » Вебмастеру » Общие вопросы от вебмастеров » Как запретить индексацию страницы? |

| Как запретить индексацию страницы? |

|

Подскажите, пожалуйста,куда необходимо вписать тег

<meta name="robots" content="noindex" /> для запрета индексации роботам страницы? В начало страницы при редактировании кода? Или куда? Вот образец, <!DOCTYPE html><html><head> <meta name="robots" content="noindex" />(…)</head> <body>(…)</body></html> но такого места на странице при редактировании нет. |

|

indiec, Дерективой прописывается в robots.txt

Код Disallow: /index/номер страницы Информация Сообщение отредактировал novikk - Воскресенье, 01 Май 2016, 07:09:08

|

|

dogothic, Вот На, нарисовался ))) А чо шифруемся ? У вас вроде другой профиль Ну ка расскажите ваши предположения. В двух словах не интересно. Факты нужны.

Может вам лучше поспорить с разрабами Поисковых систем ? Чо тут то умничать. Вот прям щас сядте и напишите Яше, и скажите, что ваши разработчики дебилы. Может они вас возьмут систему дорабатывать, исправлять ? Вы всё таки шарите. Элементарный пример приведу. Найдите любой профиль ползователя uCoz в ПС , например Мой . Найдёте ? вышлю шоколадку. ,При условии, если профиль не закрыт дерективой. Цитата User-agent: * Disallow: /a/ Disallow: /stat/ Disallow: /index/1 Disallow: /index/2 Disallow: /index/3 Disallow: /index/5 Disallow: /index/7 Disallow: /index/8 Disallow: /index/9 Disallow: /panel/ Disallow: /admin/ Disallow: /secure/ Disallow: /informer/ Disallow: /mchat Disallow: /search Disallow: /shop/order/ Disallow: /?ssid= Disallow: /index/uran_landing/0-18 Sitemap: //forum.ucoz.ru/sitemap.xml Sitemap: //forum.ucoz.ru/sitemap-forum.xml Sitemap: //forum.ucoz.ru/sitemap-shop.xml Сообщение отредактировал novikk - Воскресенье, 01 Май 2016, 14:15:33

|

|

indiec, Вам уже написали выше. Ссылка для нформации В этом посте Сообщение отредактировал novikk - Воскресенье, 01 Май 2016, 14:17:21

|

|

Через поисковик не нашел ответа. 134 страницы (по ссылке) великовато для быстрого ознакомления и решения вопроса.

Что удалось понять: 1. Исключить часть текста от индексации для поисковика Гугла тегами не получается. Для Яндекса - возможно. 2. Убрать страницу от просмотра роботами через robots.txt, который создан средствами ЮКОЗА - не возможно, если не оплачен сео-модуль. Нужно заливать свой текстовый файл. Он не будет меняться автоматически при изменении сайта. У меня мало знаний и нет пока времени, что бы учесть все нюансы для изменений в robots.txt. параллельно с изменениями на сайте, увы. Решение моей задачи нашлось иное. Спасибо за советы. |

|

Может вам лучше поспорить с разрабами Поисковых систем ? Чо тут то умничать. Вот прям щас сядте и напишите Яше, и скажите, что ваши разработчики дебилы. Может они вас возьмут систему дорабатывать, исправлять ? Вы всё таки шарите. novikk, в 2010 были подобные случаи > http://stackoverflow.com/questio....ndexing , ++ были подобные случаи > http://stackoverflow.com/questio....-not-to , ++ были подобные случаи > http://stackoverflow.com/questio....d-my-ip , примерно было это так , ( если я всё правильно помню  ) : ) :для каждого нового IP адреса / сервера , ставили роботс.тхт типо так : User-agent: Googlebot Disallow: / где то через месяц , голый IP адрес сервера , всё равно попадал в поиск гугла... да и в логах сервера , реально было видно , что гугл лезет на разные урлы сервера , которые запрещены в роботс... но это было в 2010 году... как сейчас с этим дела обстоят... я не знаю... тесты по этому поводу , мне просто влом проводить... сами понимаете... -- ставить сервак на свой комп -- цеплять домен -- регить этот домен в гугле -- писать разные версии роботс.тхт -- ждать месяц , LLL LL LL

Сообщение отредактировал _Alcyona_Haramix_ - Понедельник, 02 Май 2016, 04:12:52

|

|

_Alcyona_Haramix_, Незнаю, у меня для Яндекса свой robots.txt , для Гугла свой настроен. Не жалуюсь. Всё что мне нужно индексирует, то что мне не нужно не индексирует. Не замечал ещё косяков. А так то Гугл не предсказуем. Может брать контент, который закрыт, были такие случаи. Но ещё раз повтарюсь, что лично у меня тьфу, тьфу не было подобных случаев.

Добавлено (02 Май 2016, 11:07:25) --------------------------------------------- 1. Исключить часть текста от индексации для поисковика Гугла тегами не получается. Для Яндекса - возможно. 2. Убрать страницу от просмотра роботами через robots.txt, который создан средствами ЮКОЗА - не возможно, если не оплачен сео-модуль. Нужно заливать свой текстовый файл. Он не будет меняться автоматически при изменении сайта. У меня мало знаний и нет пока времени, что бы учесть все нюансы для изменений в robots.txt. параллельно с изменениями на сайте, увы. indiec, как это невозможно изменить ? Я что то пропустил пока отсутствовал ? Насколько я помню делаеш свой робот, заливаеш и пользуешся. Причом тут сео-модуль ? он вообще никакого отношения не имеет к редактированию вашего робота. Дайте адрес сайта и страницы которые нужно закрыть. Сообщение отредактировал novikk - Понедельник, 02 Май 2016, 11:31:05

|

|

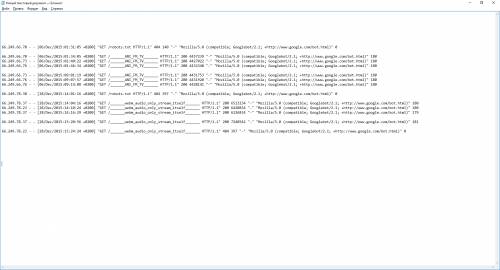

Не жалуюсь. Всё что мне нужно индексирует, то что мне не нужно не индексирует. Не замечал ещё косяков. понятно... сейчас я вспомнил ещё , что гугл у меня и , голый бесконечный MP3 радио поток , кушал... правда там роботса.тхт совсем не было... даже удалось , не совсем старые логи ( /December/2015/ ) от сервера Icecast найти , в дебрях компа... знаю что должны быть у меня , и очень старые логи , тоже когда гугл лез на радио поток , но эти логи где то на DVD+RW дисках... и их теперь фиг найдёш , среди 333+++ DVD+RW дисков...  вот скрин , со всеми логами которые удалось найти... и которые я просто вырезал в отдельный блокнот... дабы видно было более понятно и наглядно... ,  , ну да... я поэтому и написал сюда в тему , только потому , что сам , когда то давно в прошлом , сталкивался с таким...  ну значит повезло тебе...  Прикрепления:

2631194.png

(70.1 Kb)

LLL LL LL

|

|

indiec, как это невозможно изменить ? Я что то пропустил пока отсутствовал ?Насколько я помню делаеш свой робот, заливаеш и пользуешся. Причом тут сео-модуль ? он вообще никакого отношения не имеет к редактированию вашего робота. Дайте адрес сайта и страницы которые нужно закрыть. 2. Зачем мне это (закрыть от индексации страницу или текст) было надо? По двум причинам:

Увы, простых решений не оказалось. Насчет СЕО-модуля:

Это там указано. Значит - имеет отношение. Сообщение отредактировал indiec - Четверг, 05 Май 2016, 23:47:50

|

|

в robot.txt

|

|

Как запретить индексацию вот этих страниц:

http://windows-aktiv.my1.ru/dir/ http://windows-aktiv.my1.ru/dir/obratnye_ssylki/1 http://windows-aktiv.my1.ru/dir/obratnye_ssylki/1-1-0-1 Сообщение отредактировал Koba0433 - Воскресенье, 29 Май 2016, 18:34:02

|

| |||

| |||

Чат сообщества

Чат сообщества